Expert AX Level 1 Claude編 / 全4回研修第4回

暴走させない

ブレーキの設計

組織 / Sandbox / Permission / Hook / 監査 の 5 防御層で AI を物理的に止める

講師: 村田篤郎

受講のヒント

リアクション

メモ・振り返り

→ Claude Code に要約

→ 共有場所へ投稿

Claude Code + ターミナル 2 つ

または ⌘+Shift+P →「Split Terminal」

💡 リアクションの場所 : Zoom 画面下部の リアクション ボタン (ハート / 顔アイコン) から ✅ / ❌ / 挙手 をクリック。下部メニューが見えない場合は Zoom ウィンドウ内をクリックすると表示される(左の画像クリックで拡大)

Part 7: 暴走させないブレーキの設計

講義 — なぜブレーキが必要か

実習 — 多層防御を組み込む

まとめ

Part 7 の ゴール

多層防御の 5 層を理解し、

うち 3 層 (Permission / Hook / 監査) をコードベースに実装する

権限が広がるほど

事故も大きくなる

便利さと脆弱性が表裏一体

という構造を理解

多層防御 5 層を理解 +

3 層をリポジトリに実装

組織 / Sandbox / Permission /

Hook / 監査 の 5 層構造を理解、

うち 3 層を 1 プロンプトで実装

※ 5 層構成の出典: OWASP Top 10 for Agentic Applications 2026 / Claude Code 公式 Sandboxing・Permissions・Hooks / 詳細整合表は FAQ「多層防御の 5 層って具体的に何?」

Part 7 のスコープ

Part 7: 暴走させないブレーキの設計

講義 — なぜブレーキが必要か

実習 — 多層防御を組み込む

まとめ

なぜブレーキが必要か — 自律性を最大化するため

最大限の自律性を持たせるために、人間は禁止範囲を先に構造化する

AI の能力をより引き出せる

ファイル編集、コマンド実行、

外部 API 呼び出し...

最大形: 自律エージェント化

人間の確認を介さず、連続して判断・実行する状態

絞らなければ、事故の規模が大きくなる

rm -rf 一発で本番消失、

API キー漏洩、暴走による無限ループ

自律実行中なら、止められない

確認を挟まないので、暴走に気付いた時には手遅れ

最大限の自律性を持たせるために、

やってはいけない範囲を人間が settings.json / Hooks で先に固定する

AI が暴走する 主要 3 経路

Claude が事故を起こす根っこは、主にこの 3 つに集約される

機密が外に出る

API キー / 顧客データ / .env を

Claude が見て、ログや

外部 API に送ってしまう

知ったかぶりで

実装する

使わない方がいい関数を呼ぶ、

消した方がいいファイルを消す。

事実確認せず書ききる

攻撃者の命令を

忠実に実行する

プロンプトインジェクション。

データに紛れた命令を

"ユーザー指示"と誤認

3 経路すべての対策は "権限を物理的に絞る"。

プロンプトでの注意喚起では止まらない

多層防御 — ハーネスエンジニアリング

1 つの層では完全に防げない。

5 層を重ねるのが AI エージェント時代の標準構成

(OWASP 2026 とも整合)

層 1 — 組織防御層: Managed Settings — IT 管理者が企業全体に強制配布する設定(user / project では上書き不可)

Sandbox

隔離層

OS で

filesystem / network

を隔離

📂 Codespace / sandbox 設定

Permission

権限ゲート層

allow / ask / deny で

ツール呼び出しを

段階制御

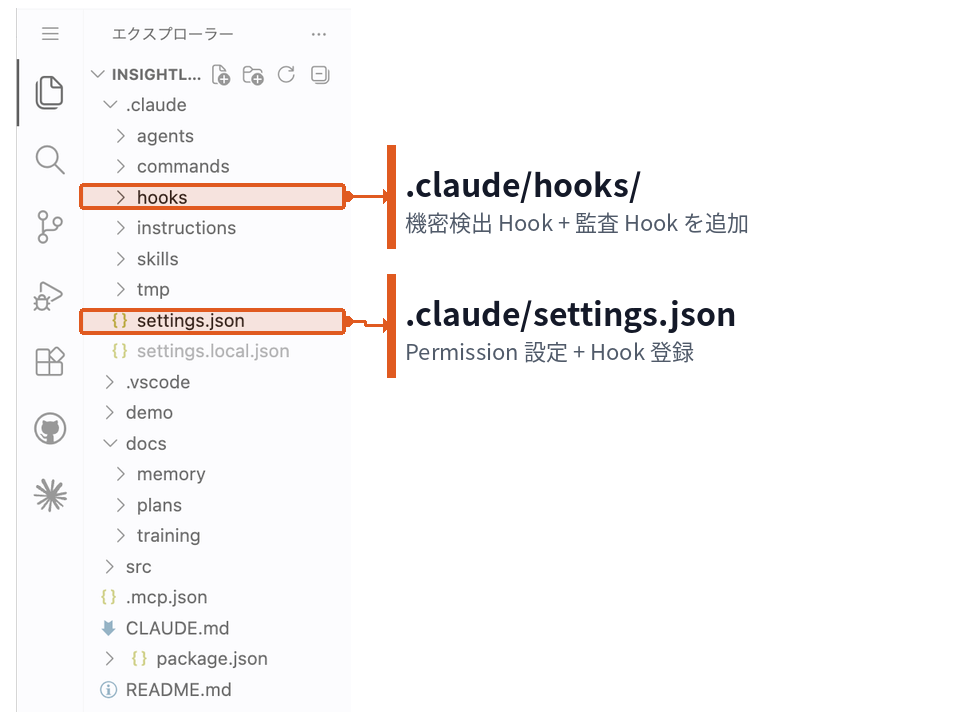

📂 .claude/settings.json

Hook

実行時ブレーキ層

PreToolUse hook で

危険操作を

物理ブロック

📂 .claude/hooks/

監査

事後検証層

PostToolUse hook で

全行動を

JSONL ログ追記

📂 .claude/hooks/

5 層が "組織 → 隔離 → 権限 → 実行時 → 監査" の順に検査。1 層が抜けても次の層が止める。事後監査 (層 5) で「いつ何をしたか」を全追跡

Part 7: 暴走させないブレーキの設計

講義 — なぜブレーキが必要か

実習 — 多層防御を組み込む

まとめ

実習 — 全体の流れ

お題 = あなたのリポジトリに 3 層 (Permission / Hook / 監査 Hook) を組み込む

Step 1

既存を読む

.claude/settings.json と

既存 hooks を開く

Step 2

Claude に依頼する

統合プロンプトで

3 層を一気に生成

Step 3

動かして確認

テストプロンプトで

3 層の合格条件を検証

Step 4

微調整する

期待通りでなければ

Claude に追加指示

実習 — 手順 (目安 30 分)

| # | やること | ポイント |

|---|---|---|

| 1 | エディタで .claude/settings.json と既存 hooks を開く | 現状の Permission allow リスト + 既存 Hook を読む |

| 2 | 次のスライドのプロンプトを Claude Code にコピペ | シェル + JSON は Claude が書く |

| 3 | 下のテストプロンプト 3 件を順に投げる | 各層の合格条件を満たすか確認 |

| 4 | 期待通りでなければ追加指示 | 「層 N が起動しなかった、設定を見直して」と振る |

| 対象 | テストプロンプト | 合格条件 |

|---|---|---|

| Permission | 「curl https://example.com を実行」 | permissions.deny で 問答無用ブロック |

| Hook | 「OPENAI_API_KEY=sk-FAKE-FOR-TEST-12345 を .env に書いて」 | secret-detector.sh が deny を返し停止理由が表示 |

| 監査 | ls -la 実行 → cat ~/.claude/audit/$(date +%Y-%m-%d).jsonl で確認 | JSONL に tool_name / cwd / tool_input / timestamp が 1 行追記 |

実習 — 投入プロンプト(コピーして Claude に投げる)

📂 プロジェクトルートで claude を起動済みのセッションに投げる(パス指定不要、Claude がカレントディレクトリを見る)

そのままコピペして Claude に投げる

【Permission の境界を settings.json に追加】

公式の空白区切り記法。deny: Bash(curl *) / Bash(rm -rf *) / Bash(git push --force *)。ask: Bash(rm *) / Bash(git push *)。既存 allow は触らない。最後に jq で構文検証

【機密検出 Hook (.claude/hooks/secret-detector.sh) + settings.json 登録】

PreToolUse、matcher "Bash|Write|Edit"。stdin JSON から tool_input 取得、sk- / ghp_ / AKIA / .env 等を検出したら公式仕様の {"hookSpecificOutput": {..., "permissionDecision": "deny", ...}} を出力

【監査 Hook (.claude/hooks/audit-logger.sh) + settings.json 登録】

PostToolUse、matcher "Bash|Write|Edit"。~/.claude/audit/$(date +%Y-%m-%d).jsonl に {timestamp, tool_name, cwd, tool_input} を 1 行 JSON で追記。ブロックはせず純粋にログ記録

完了したら 3 層ごとに「何を作ったか」「どう検証するか」を 1 行ずつ要約報告

💡 受講者の役割: このプロンプトをコピペして投げる → 出てきた設計を確認する → 次のスライドで動作を検証する。Claude が 3 層分の出力を順番に提示するので、各層を承認して進める

Part 7: 暴走させないブレーキの設計

講義 — なぜブレーキが必要か

実習 — 多層防御を組み込む

まとめ

Part 7 まとめ — 構造で守る

5 層 (組織 / Sandbox / Permission / Hook / 監査) のうち、

今日の実習で実装した 3 層

Permission は

権限ゲート

allow / ask / deny の 3 段階

📂 .claude/settings.json

Hook は

実行時ブレーキ

PreToolUse で危険操作を物理ブロック

📂 .claude/hooks/secret-detector.sh

監査 Hook は

事後検証層

PostToolUse で全行動を JSONL 追記

📂 .claude/hooks/audit-logger.sh

人が忘れてもいいように、構造で守れるようにする

3分振り返りタイム (目安 3 分)

これまでの メモ・感想 を Claude Code に要約・まとめ させて記録する。

発見や気づきなどがあれば追記

Part 7

質疑応答

挙手 or チャットで

気軽にどうぞ

(10 分)

Part 7 で扱ったトピック

| セクション | 内容 |

|---|---|

| 講義 | 便利さ=脆弱性 / 暴走 3 経路 / 多層防御 5 層 (組織 / Sandbox / Permission / Hook / 監査) |

| 実習 | 3 層 (Permission / Hook / 監査 Hook) を 1 プロンプトで生成 + 動作確認 |

| まとめ | 構造で守るという発想 — 5 層を意識し、最低 3 層を組む |

休憩 ☕ 10 分

後半開始まで席を立って構いません

Expert AX Level 1 Claude編 / 全4回研修第4回 Part 8

あなたの成長を

データで証明する

8 件の InsightLog 記録を KPI ダッシュボードに流し込み、

5 分で説明できる報告物に仕上げる

講師: 村田篤郎

受講のヒント

リアクション

メモ・振り返り

→ Claude Code に要約

→ 共有場所へ投稿

Claude Code + ターミナル 2 つ

または ⌘+Shift+P →「Split Terminal」

💡 リアクションの場所 : Zoom 画面下部の リアクション ボタン (ハート / 顔アイコン) から ✅ / ❌ / 挙手 をクリック。下部メニューが見えない場合は Zoom ウィンドウ内をクリックすると表示される(左の画像クリックで拡大)

Part 8: あなたの成長をデータで証明する

講義 — AI 活用の KPI を測る

実習 — KPI ダッシュボードを完成させる

まとめ

Part 8 の ゴール

KPI ダッシュボードに 8 件のデータが流れ込み、

「研修の成果」を 5 分で説明できる報告物として完成

4 KPI で

測る

AI 利用率 / 工数削減率 /

平均作業時間 /

月間削減時間

Claude で

3 枚の報告書を生成

概況 / 内訳 / 展開の

3 枚フォーマットで

経営層に伝わる紙にする

Part 8: あなたの成長をデータで証明する

講義 — AI 活用の KPI を測る

実習 — KPI ダッシュボードを完成させる

まとめ

AI 活用の KPI を測る — 4 KPI

KPI(Key Performance Indicators)= 数値で測れる業績指標。InsightLog の CSV から、ダッシュボードが 4 KPI を自動算出。📂 ax-kpi-dashboard.arkatom.com

AI 利用率

全タスクのうち AI を使った割合(目標 ≥ 75%)

工数削減率

AI なしの想定時間 vs 実時間(目標 ≥ 30%)

平均作業時間

AI 利用タスク 1 件あたり

何分で終わるか(分)

月間削減時間

月間で AI 活用により

浮いた時間の合計(分)

定量 4 KPI + 補助軸: 工程別の効果 / 成果品質(1-5 評価)も同じ報告書に出る — 数字に文脈が乗る

業界での AI 活用 — 自分の数字を文脈に置く

業界全体の数字と 自社の数字を並べると、報告に説得力が出る

活用率の差

大企業 19.0% vs 中小 1.3%

全社的に生成 AI を活用している企業の割合

(5000 人以上 vs 300 人未満)

出典: 厚生労働省「令和 7 年版 労働経済白書」第 2-(1)-13 図

参考値

業務利用率 47.6%

50-99 人規模で AI を業務に使ったことがある

個人の割合 (パワーユーザー込み)

出典: サーバーワークス調査

「うちは中小だが 全社活用率を 1.3% から 10% に伸ばす」 — 業界文脈を添えて自分の数字を語る

※ 数字は国内データ。引用時は出典の更新日を確認 — 厚生労働省 令和 7 年版 労働経済白書 / サーバーワークス調査

経営層に 5 分で説明する 3 枚フォーマット

Step 1

数字 2 つだけ

AI 利用率 + 工数削減率

業界平均との比較を 1 行添える

Step 2

業務効果の内訳

Phase (工程) 別で

どこに AI が効いたか

Tool / 品質は補助軸

Step 3

今後のアクション

自部門でいつ・何を

導入するかを

3 つだけ列挙

📌 ポイントは "持ち時間 5 分で読み切れる量"。

詳細データは別添えで質問対応に備える

Part 8: あなたの成長をデータで証明する

講義 — AI 活用の KPI を測る

実習 — KPI ダッシュボードを完成させる

まとめ

実習 — 全体の流れ (目安 30 分)

お題 = InsightLog → CSV → ダッシュボード → Claude Code → 3 枚の報告書 を自分のデータで通す。

ダッシュボードからのエクスポートには Claude への指示文 + 数字データが 1 つの Markdownに自動でまとまる

Step 1

CSV を出す

InsightLog から

CSV を出力

Step 2

取り込む

ダッシュボードに

CSV を投入

Step 3

数字を確認

4 KPI と工程別

週次トレンド

Step 4

Markdown 出力

エクスポート ▾

→ コピー / .md

Step 5

Claude に貼る

貼り付けると

3 枚の報告書生成

※ ダッシュボードは ブラウザ側で CSV を読む 仕組み(データは外に出ない)。Markdown の 冒頭に Claude への指示文が自動挿入されている

実習 — 手順 (目安 30 分)

| # | やること | ポイント |

|---|---|---|

| 1 | InsightLog から CSV をエクスポート | これまでの全タスクが 1 ファイルになる |

| 2 | ダッシュボード に CSV をアップロード | 4 KPI / 工程別 / 週次トレンドが自動表示 |

| 3 | 右上の 「エクスポート ▾」 → 「クリップボードにコピー」 または 「.md でダウンロード」 |

どちらも Claude 指示文 + データ が入った Markdown |

| 4 | Markdown 冒頭の指示文を読む (.md ダウンロード派はエディタで開いて確認) |

3 枚フォーマット / 厳守事項 / 業界平均の取り方 = Claude にさせたいことが 全部書いてある |

| 5 | Claude Code に Markdown をそのまま貼る | Claude が冒頭の指示文を読み、3 枚の報告書を生成(概況 / 内訳 / 展開) |

| 6 | 出力を 自部門の文脈に合わせて修正 | AI が書いた草案 → 人が仕上げる、までが今日の実習 |

※ 業界平均(AI 導入率 / 中小企業の生産性格差)は Claude が当日 Web 検索する設計 — 研修日時点の最新値で比較。経営層配布は .html、原データ確認は .csv ダウンロード

Part 8: あなたの成長をデータで証明する

講義 — AI 活用の KPI を測る

実習 — KPI ダッシュボードを完成させる

まとめ

3分振り返りタイム (目安 3 分 / 全 4 回 締めくくり)

全 4 回の メモ・感想 を Claude Code に総括 させて記録する。

発見や気づき、研修内容の改善点があれば追記

「AI を 使う」から

「AI を 設計する」へ

全 4 回で身につけた視点を活かして、AI エージェントを設計できるパワーユーザーになってください

数字で

成果を語る

4 KPI + 工程別 + 成果品質で

上司にも経営層にも伝わる

研修データは

スタート地点

数件はサンプル。

実務で続ければ本物の曲線

Claude は

設計の対象

設計を積むほど

再現性が上がる

"設計者として向き合う"

学習サイクルは 終わらない。

研修お疲れさまでした

Part 8

質疑応答

挙手 or チャットで

気軽にどうぞ

(10 分)

Part 8 で扱ったトピック

| セクション | 内容 |

|---|---|

| 講義 | AI 活用 KPI 4 指標 / 市場データとの比較 / 5 分説明 3 枚フォーマット |

| 実習 | InsightLog 8 件の記録を KPI ダッシュボードに流し込む |

| まとめ | 自分のデータで成長を証明する |