Expert AX Level 1 Claude編 / 全4回研修第2回

精度を上げる、

精度を上げ続ける

仕様駆動開発とマルチモーダル / 継続改善サイクル

講師: 村田篤郎

受講のヒント

リアクション

メモ・振り返り

→ Claude Code に要約

→ 共有場所へ投稿

Claude Code + ターミナル 2 つ

または ⌘+Shift+P →「Split Terminal」

💡 リアクションの場所 : Zoom 画面下部の リアクション ボタン (ハート / 顔アイコン) から ✅ / ❌ / 挙手 をクリック。下部メニューが見えない場合は Zoom ウィンドウ内をクリックすると表示される(左の画像クリックで拡大)

Part 3: 「とりあえず作って」が破綻する理由

講義 — 仕様駆動開発とマルチモーダル

実習 — マルチモーダルで仕様駆動開発を体験する

まとめ

Part 3 の ゴール

仕様駆動開発の一連の流れを体験し、

Plan を立ててから実装することの重要性を理解する

仕様駆動開発

コードを書く前に

実装計画を確定させる

マルチモーダル開発

画像を仕様として

AI に渡す

Plan → 実装 → 検証

Playwright MCP で

見た目を自動検証

Part 3 のスコープ

Part 3: 「とりあえず作って」が破綻する理由

講義 — 仕様駆動開発とマルチモーダル

実習 — マルチモーダルで仕様駆動開発を体験する

まとめ

実装計画なしで作り始めると 起きる問題

ある程度大きなタスクで設計を飛ばすと起きる典型的な問題

手戻りの連鎖

「思ってたのと違う」が

実装後に発覚する

トークンの浪費

試行錯誤のたびに

APIコストが積み上がる

速く作れる = 手戻りとコストが膨らむ からこそ、

「何を」「どう作るか」の定義 が結果を分ける

参考 — モデル使い分けで コスト最適化

タスクの重さでモデルを選ぶと、コストは 1/25 まで圧縮できる (MTok = 100 万トークン)

Haiku 4.5

入力 $1 / 出力 $5 MTok

探索 / 軽量読み取り / 大量処理

Sonnet 4.6

入力 $3 / 出力 $15 MTok

通常の実装 / レビュー / テスト

Opus 4.7

入力 $5 / 出力 $25 MTok

複雑設計 / Plan / 大規模理解

出典: Anthropic Pricing 公式 / 詳細な使い分け方針: arkatom/claude-plugins — subagent-policy.md

SDD(仕様駆動開発)とは

コードを書く前に、AI に実装計画を立てさせて確定する

仕様(What)

何を作るかを言語化する

仕様書や Issue など

実装計画(How)

技術設計とタスク分解を

AI に立てさせ人間がレビュー

実装(Do)

確定した計画に基づき

コードを書く

SDD は 開発の前提 になりつつある

仕様駆動開発を前提にしたツールが標準化されている

Spec-driven IDE

AWS が提供する仕様駆動の AI IDE。

EARS 記法で要件を構造化し、

仕様から実装まで一貫して管理

オープンソース SDD ツール

GitHub が公開した SDD ツールキット。

PRD を起点に計画を自動生成

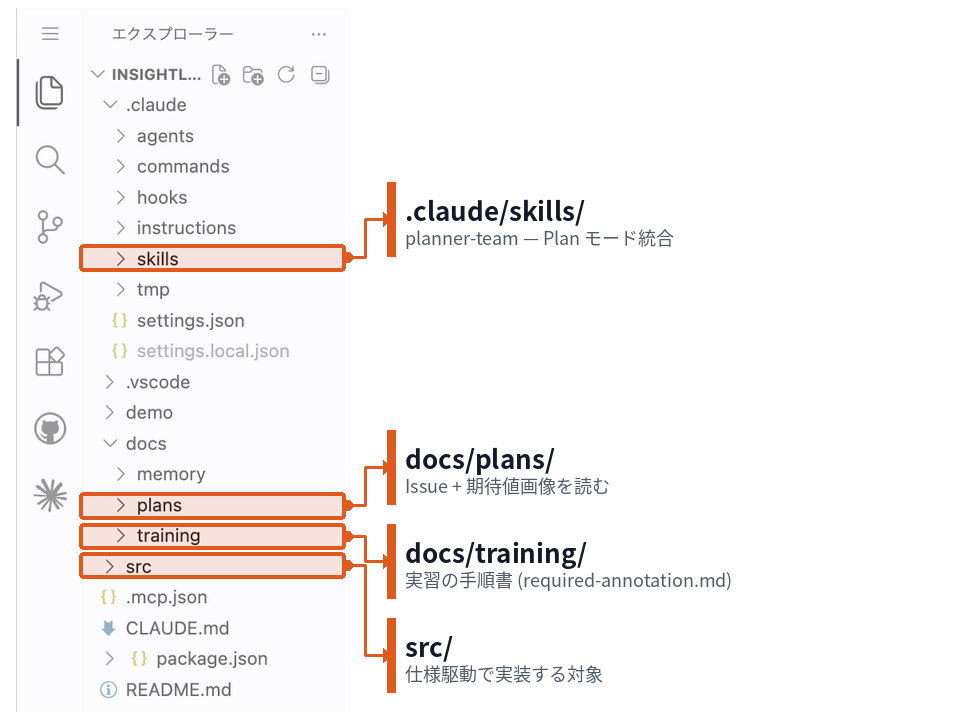

Claude Code では Plan モード が 計画段階 を担う

仕様 (Issue / PRD / 受け入れ条件) は組織側で別途作る

Plan モード — AI に 実装計画 を出させて 人間がレビュー

Plan モードで

要件を入力

AI が

実装計画を出力

人間が

レビュー・承認

承認後

自動で実装開始

AI の提案を鵜呑みにしない — Plan をレビューして修正指示を出す体験が核心

マルチモーダル開発 — 画像を仕様として扱う

テキストだけでは伝えきれないもの = デザイン

画像を仕様として渡す

デザイン画像を Claude Code に

直接読み込ませる。

Figma MCP でも画像ファイルでも可

Playwright MCP で自動検証

実装後のスクリーンショットを

自動撮影し、見た目が

画像通りか確認

今日の実習: リポジトリ内の見本画像を使う(Figma なしでも同じフローを体験できる)

Part 3: 「とりあえず作って」が破綻する理由

講義 — 仕様駆動開発とマルチモーダル

実習 — マルチモーダルで仕様駆動開発を体験する

まとめ

実習 — バイブコーディング vs SDD を比べる (目安 30 分)

Phase 1 バイブコーディング

- お題をそのまま Claude にコピペ

- ブラウザで結果を確認

Phase 2 SDD で作り直す

- 変更を戻す: !git restore .

- Plan モード切替 (Shift + Tab)

- お題 + Issue + 画像 (docs/plans/) を渡して実装計画立案

- 実装計画 をレビュー → 承認

- VS Code に開いたスクリーンショットで結果を確認

📂 Phase 2 ステップ 3 詳細: 下の 2 ファイルを VS Code エクスプローラーから Shift + ドラッグ で Claude 入力欄に投下 → お題プロンプトを続けて貼る

- docs/plans/必須フィールドにバリデーション表示を追加.issue.md

- docs/plans/必須デザイン期待値_デザイナーコメントあり.png

Part 3: 「とりあえず作って」が破綻する理由

講義 — 仕様駆動開発とマルチモーダル

実習 — マルチモーダルで仕様駆動開発を体験する

まとめ

Part 3 まとめ — SDD で何が変わるか

手戻りが減る

Plan の段階で問題を潰すから

「思ってたのと違う」がなくなる

AI が確実に

実装できる

計画が明確なら AI は迷わない

結果が予測可能になる

画像で

認識のズレを防ぐ

マルチモーダル入力で

デザインの意図を正確に伝える

Plan を確定させてから実装する — たったこれだけで手戻りとコストが劇的に減る

3分振り返りタイム (目安 3 分)

これまでの メモ・感想 を Claude Code に要約・まとめ させて記録する。

発見や気づきなどがあれば追記

Part 3

質疑応答

挙手 or チャットで

気軽にどうぞ

(10 分)

Part 3 で扱ったトピック

| セクション | 内容 |

|---|---|

| 講義 | SDD(仕様駆動開発) / マルチモーダル開発 / Plan モード |

| 実習 | バイブコーディング vs SDD で同じお題を 2 通り作って比較 |

| まとめ | SDD で何が変わるか — 手戻り削減 / 実装精度 / 認識ズレ防止 |

休憩 ☕ 10 分

後半開始まで席を立って構いません

Expert AX Level 1 Claude編 / 全4回研修第2回 Part 4

部下を「育てる」

仕組みを作る

Claude Code を育てる PDCA

講師: 村田篤郎

受講のヒント

リアクション

メモ・振り返り

→ Claude Code に要約

→ 共有場所へ投稿

Claude Code + ターミナル 2 つ

または ⌘+Shift+P →「Split Terminal」

💡 リアクションの場所 : Zoom 画面下部の リアクション ボタン (ハート / 顔アイコン) から ✅ / ❌ / 挙手 をクリック。下部メニューが見えない場合は Zoom ウィンドウ内をクリックすると表示される(左の画像クリックで拡大)

Part 4: 部下を「育てる」仕組みを作る

講義 — なぜ継続改善が必要か

講義 — 継続改善サイクルの設計

実習 — 振り返りと改善サイクルを体験

講義 — エコシステムの追いかけ方

まとめ

Part 4 の ゴール

Claude Code を 育て続ける仕組み を手に入れ、

改善サイクルを自分で回せるようになる

継続改善の必要性

設定は全て

改善し続けるもの

改善サイクルの体験

observe → evolve スキルで

改善提案を自動生成・適用

エコシステムの把握

公式情報の追いかけ方と

コミュニティリソース

Part 4 のスコープ

Part 4: 部下を「育てる」仕組みを作る

講義 — なぜ継続改善が必要か

講義 — 継続改善サイクルの設計

実習 — 振り返りと改善サイクルを体験

講義 — エコシステムの追いかけ方

まとめ

なぜ 継続改善 が必要か

育てる ことで使いやすくなり、

自分や自分の組織に 1 番適した形 へ

設定とワークフローが 最適化されていく

/insights — 出力をどう使うか

セッション履歴を自動分析し、摩擦と改善提案をレポート化。

受け取った後の 育て方 がメイン

① 読む

摩擦と

改善提案を確認

② 判断

採用するもの/

しないものを選別

③ 反映

CLAUDE.md / Skills /

Hooks に落とす

分析 → 判断 → 反映 で 設定とワークフローが 育つ

※ /insights は Claude Code の 組み込みスラッシュコマンド

Part 4: 部下を「育てる」仕組みを作る

講義 — なぜ継続改善が必要か

講義 — 継続改善サイクルの設計

実習 — 振り返りと改善サイクルを体験

講義 — エコシステムの追いかけ方

まとめ

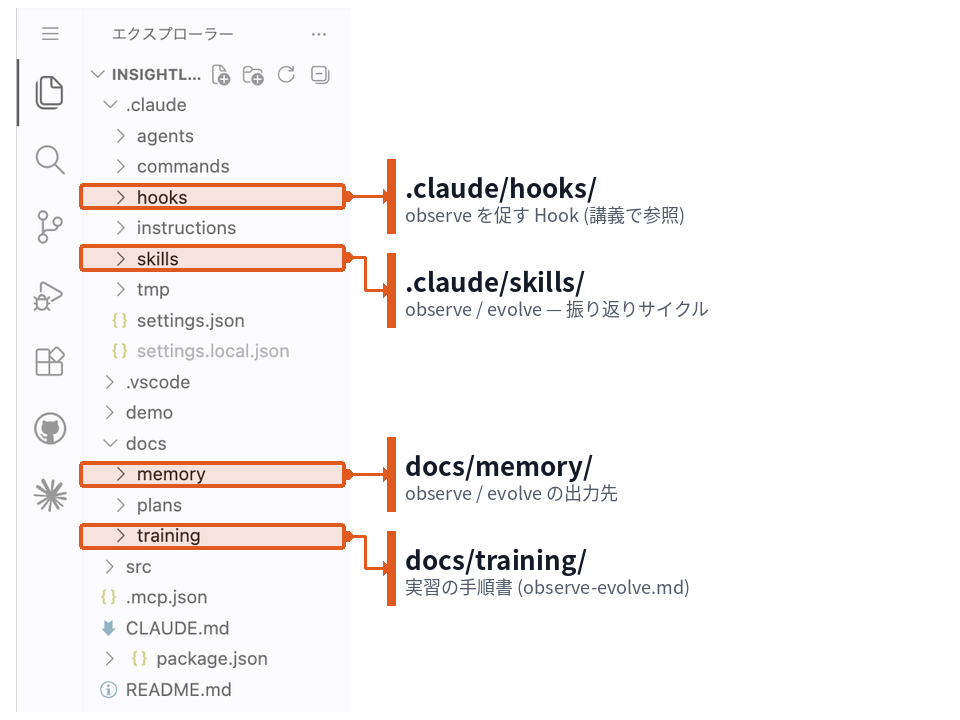

継続改善サイクル — Claude Code を 育てる仕組み

/observe スキル

セッションを振り返り

品質スコアリング

改善点を自動検出・提案

/evolve スキル

低リスクは自動適用

高リスクは人間が判断

効果を検証

低リスクは 自動適用、高リスクは あなた が判断する

この仕組みは OpenClaw(OSS)の継続改善フレームワークの思想を模倣

Part 4: 部下を「育てる」仕組みを作る

講義 — なぜ継続改善が必要か

講義 — 継続改善サイクルの設計

実習 — 振り返りと改善サイクルを体験

講義 — エコシステムの追いかけ方

まとめ

実習 — 振り返りと 改善サイクル を体験 (目安 20 分)

デモ用の振り返りデータと改善提案が事前に配置されています

/observe 実行

振り返りデータを分析

品質採点 + 改善提案を生成

提案を確認

3件の改善提案

採用すべきか判断

/evolve 実行

採否を決定

設定に反映

📄 手元で手順を開く: /training observe-evolve

実習 — 手順 (目安 20 分)

- /observe を実行 → デモ用の振り返りデータを分析し、改善提案を生成

- improvements.md に 3件の proposed を確認

- /evolve を実行 → 各提案の 採用・却下を判断

- 変更内容の差分を確認 → InsightLog に記録

① CLAUDE.md にコンポーネント配置ルール追記 / ② npm run dev 自動実行フック追加 / ③ ユーザー制約ヒアリング強化

判断のポイント: リスクに見合う効果があるか? / 過剰な自動化になっていないか?

Part 4: 部下を「育てる」仕組みを作る

講義 — なぜ継続改善が必要か

講義 — 継続改善サイクルの設計

実習 — 振り返りと改善サイクルを体験

講義 — エコシステムの追いかけ方

まとめ

Claude Code エコシステムの 追いかけ方

常時チェック ✅

1 つ試してみる

公式 install ルート

Vercel 運営 / SKILL.md オープン標準

skill / template 事例集

⚠️ コミュニティは身構える ファクトチェック / 情報商材注意 / skill・plugin はインストール前にセキュリティ監査

Part 4: 部下を「育てる」仕組みを作る

講義 — なぜ継続改善が必要か

講義 — 継続改善サイクルの設計

実習 — 振り返りと改善サイクルを体験

講義 — エコシステムの追いかけ方

まとめ

Part 4 まとめ — Claude Code を育てる

観察する

/insights で

ワークフローの現状を可視化

改善を

回し続ける

observe → evolve の

サイクルで

Claude Code を育て続ける

人間が

判断を握る

自動化する範囲と

判断を残す範囲を切り分ける

観察 → 改善 → 判断のサイクルで — Claude Code は使うほど賢くなる

3分振り返りタイム (目安 3 分)

これまでの メモ・感想 を Claude Code に要約・まとめ させて記録する。

発見や気づきなどがあれば追記

Part 4

質疑応答

挙手 or チャットで

気軽にどうぞ

(10 分)

Part 4 で扱ったトピック

| セクション | 内容 |

|---|---|

| 講義 | なぜ継続改善が必要か |

| 講義 | 継続改善サイクルの設計(observe / evolve) |

| 実習 | /observe と /evolve を実行して振り返り → 改善を体験 |

| 講義 | エコシステムの追いかけ方 |